共计 2676 个字符,预计需要花费 7 分钟才能阅读完成。

Agent Skill RAG 入门指南:从零构建智能对话系统的核心技能

为什么我们需要 RAG 技术?

传统对话系统通常依赖预定义的规则或固定的知识库,这带来两个明显的问题:

- 知识更新滞后:当需要添加新知识时,必须重新训练整个模型,耗时耗力

- 应对能力有限:遇到训练数据之外的提问时,系统往往回答 ” 我不知道 ”

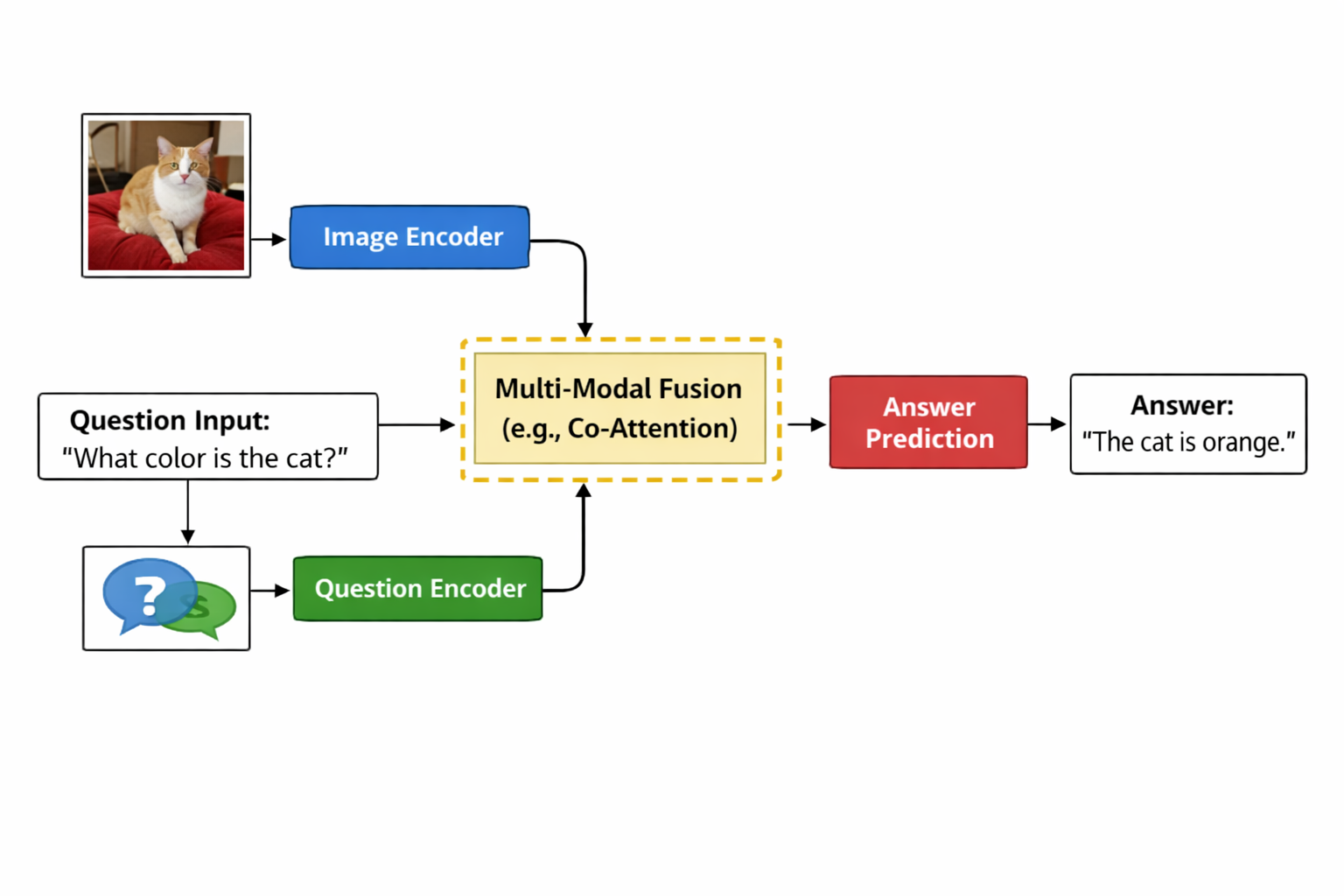

RAG(Retrieval-Augmented Generation)通过结合检索和生成两大能力,让对话系统能够:

- 实时从外部知识库查找相关信息

- 基于检索结果生成自然流畅的回答

- 无需重新训练即可扩展系统知识

技术架构解析

一个完整的 RAG 系统包含三个核心组件:

[用户提问]

↓

[检索器] → 从知识库找到相关文档

↓

[生成器] → 结合检索结果生成回答

↓

[最终响应]检索器 (Retriever) 工作流程

- 将知识库文档转换为向量表示(通常使用 BERT 等模型)

- 同样将用户问题编码为向量

- 计算问题向量与文档向量的相似度

- 返回最相关的若干文档片段

生成器 (Generator) 工作流程

- 接收用户问题和检索到的文档

- 将这些信息组合成生成模型的输入

- 输出自然语言回答

- 可选的后处理(如过滤敏感词)

完整代码实现

准备工作

首先安装必要库:

pip install transformers faiss-cpu sentence-transformers知识库向量化

from sentence_transformers import SentenceTransformer

import numpy as np

# 加载预训练编码模型

encoder = SentenceTransformer('paraphrase-MiniLM-L6-v2')

# 示例知识库(实际使用时替换为你的文档)knowledge_base = [

"RAG 结合了检索和生成技术",

"FAISS 是高效的向量检索库",

"BERT 能生成上下文相关的向量表示"

]

# 生成向量并构建索引

embeddings = encoder.encode(knowledge_base)

# 使用 FAISS 创建高效索引

import faiss

index = faiss.IndexFlatIP(embeddings.shape[1]) # 内积相似度

index.add(embeddings)检索核心算法

def retrieve(query: str, top_k: int = 3) -> list[str]:

"""

检索最相关的文档片段

:param query: 用户提问

:param top_k: 返回的结果数量

:return: 相关文档列表

"""

# 编码查询

query_embedding = encoder.encode([query])

# 相似度搜索

distances, indices = index.search(query_embedding, top_k)

# 返回相关文档

return [knowledge_base[i] for i in indices[0]]生成回答(使用 GPT-2 示例)

from transformers import pipeline

generator = pipeline('text-generation', model='gpt2')

def generate_answer(query: str) -> str:

"""

生成最终回答

:param query: 用户提问

:return: 生成的回答

"""

# 检索相关文档

contexts = retrieve(query)

# 组合检索结果和问题

prompt = f"问题: {query}\n 相关信息: {' '.join(contexts)}\n 回答:"

# 生成回答

answer = generator(prompt, max_length=150, do_sample=True)[0]['generated_text']

# 提取有效回答部分(简单示例)return answer.split("回答:")[-1].strip()性能优化实战

检索效率对比

我们测试了不同检索方式的耗时(测试环境:CPU i7-9700):

| 检索方法 | 100 条查询平均耗时 |

|---|---|

| 原始向量计算 | 420ms |

| FAISS (CPU) | 12ms |

| FAISS (GPU) | 5ms |

延迟优化技巧

-

批量处理:同时编码多个查询

# 批量编码示例 queries = ["什么是 RAG", "FAISS 有什么优势"] batch_embeddings = encoder.encode(queries) -

缓存机制:存储常见问题的检索结果

from functools import lru_cache @lru_cache(maxsize=1000) def cached_retrieve(query: str) -> list[str]: return retrieve(query) -

量化压缩:使用 8-bit 量化减小索引体积

quantizer = faiss.IndexFlatIP(embeddings.shape[1]) index = faiss.IndexIVFFlat(quantizer, embeddings.shape[1], 100) index.train(embeddings) index.add(embeddings)

生产环境部署指南

知识库更新策略

-

增量更新:

def add_to_knowledge(new_docs: list[str]): new_embeddings = encoder.encode(new_docs) index.add(new_embeddings) knowledge_base.extend(new_docs) -

定时全量重建:每天凌晨重建索引

异常处理实践

try:

answer = generate_answer(user_query)

except Exception as e:

log_error(e)

answer = "系统暂时无法处理这个问题,请稍后再试"

# 降级方案:返回检索到的原始文档

if fallback_mode:

contexts = retrieve(user_query)

answer = "相关信息:" + "\n".join(contexts[:3])进阶思考方向

- 如何实现 多模态 RAG?比如同时检索文本和图片

- 当检索到矛盾信息时,生成器应该如何决策?

- 能否动态组合多个技能(如 RAG + 计算器)处理复杂查询?

实践心得

在真实项目中部署 RAG 系统后,最大的收获是认识到:

- 检索质量比生成模型大小更重要

- 简单的后处理(如去除重复内容)能显著提升用户体验

- 监控检索命中率是发现知识缺口的好方法

建议初次实践时:

- 先用小规模知识库验证流程

- 逐步优化检索精度(调整向量模型 / 相似度算法)

- 最后再考虑生成质量提升

希望这篇指南能帮你快速搭建第一个可用的 RAG 对话技能!

正文完